随着人工智能系统日益融入我们的日常生活,伦理考量已从学术讨论转变为实际需求。AI伦理涉及指导人工智能技术开发与使用的道德原则和准则。

为何AI伦理至关重要

AI系统可能放大人类偏见、做出改变人生的决策,并在人类无法直接监督的规模上运作。若缺乏伦理准则,AI可能造成伤害、加剧不平等并侵蚀公众信任。

核心伦理原则

1. 公平性与非歧视

AI系统应公平对待所有个体和群体,无偏见或歧视。这需要仔细关注训练数据、算法设计和部署环境。

2. 透明性与可解释性

AI决策应让受影响者能够理解。无法解释其输出的“黑盒”系统可能损害信任与问责。

3. 隐私与数据保护

AI系统常处理敏感个人数据。强有力的隐私保护与数据治理对于防止滥用和保护个人权利至关重要。

4. 安全性与可靠性

AI系统必须安全、可靠,尤其是在医疗、交通、金融等关键领域部署时。

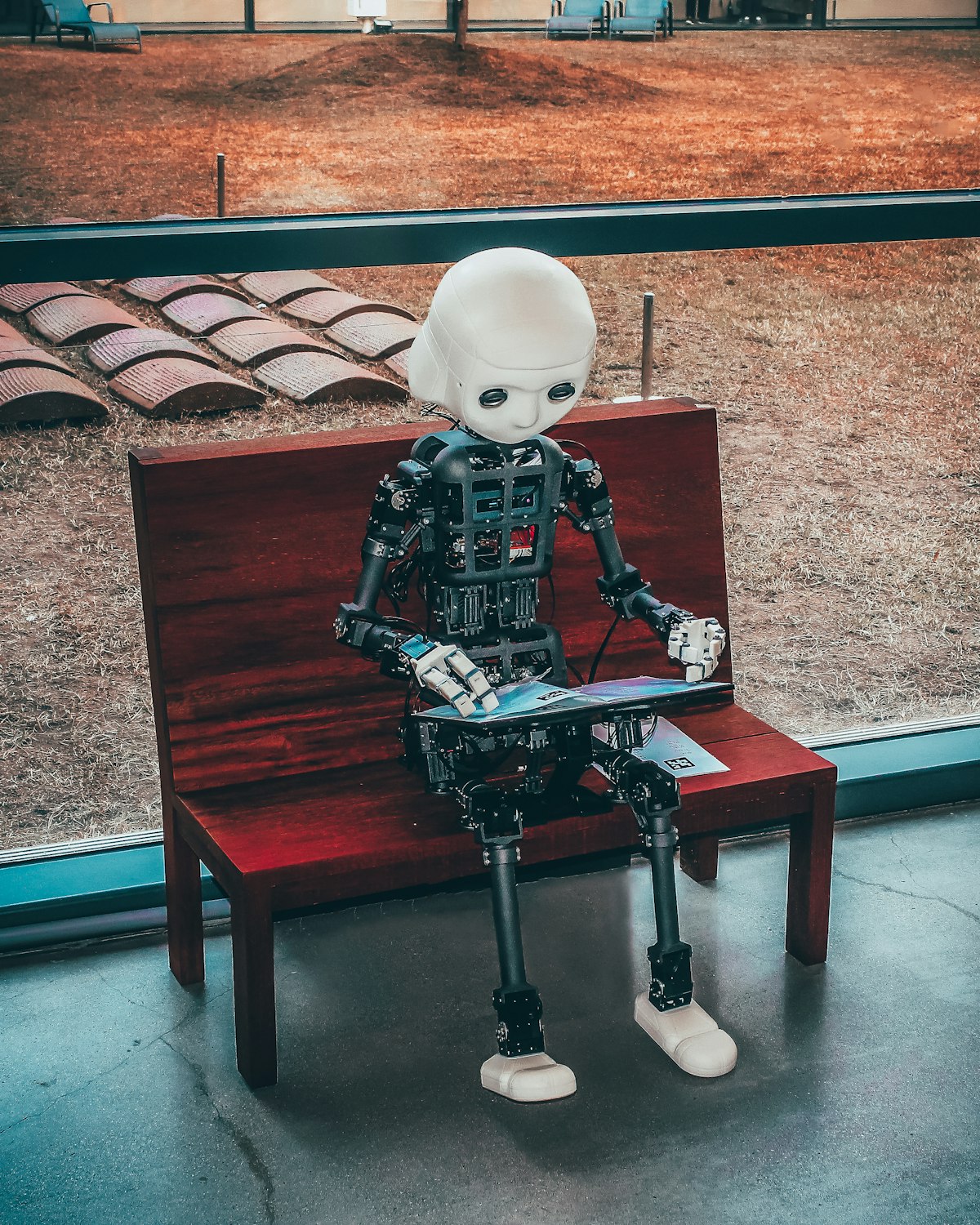

5. 人类控制与监督

人类应保留对AI系统的实质性控制,能够在必要时干预、覆盖或关闭系统。

“完全人工智能的发展可能意味着人类的终结。它将自行起飞,并以不断增长的速度重新设计自己。” — 史蒂芬·霍金

现实世界中的伦理挑战

算法偏见

训练数据中的历史偏见可能导致AI系统延续或放大歧视。示例包括:

- 面部识别系统在深肤色个体上表现不佳

- 贷款审批算法歧视特定人口群体

- 招聘工具偏爱特定背景的候选人

自主武器

致命性自主武器的发展引发了关于将生死决策委托给机器的深刻道德问题。

就业替代

AI驱动的自动化可能替代数百万工人,需要深思熟虑的再培训和社会安全网方法。

深度伪造与虚假信息

AI生成的合成媒体可创建令人信服的假视频、音频和文本,对民主、安全和个人声誉构成风险。

伦理AI开发框架

1. 设计即伦理

将伦理考量融入AI开发生命周期的全过程,从问题定义到部署与监控。

2. 影响评估

在部署AI系统前,对潜在的伦理风险和社会影响进行全面评估。

3. 多学科团队

除了工程师和数据科学家,还应纳入伦理学家、社会科学家和领域专家。

4. 公众参与

让包括受影响社区在内的多元利益相关者参与AI开发与治理的讨论。

实施伦理AI:实用清单

# 示例:分类模型中的偏见检测

import pandas as pd

import numpy as np

from sklearn.model_selection import train_test_split

from sklearn.ensemble import RandomForestClassifier

from sklearn.metrics import classification_report

import matplotlib.pyplot as plt

def check_fairness(model, X_test, y_test, sensitive_attribute):

"""

检查模型在不同群体间的公平性

"""

predictions = model.predict(X_test)

# 按组计算指标

groups = X_test[sensitive_attribute].unique()

fairness_report = {}

for group in groups:

group_mask = X_test[sensitive_attribute] == group

if sum(group_mask) > 0:

group_accuracy = np.mean(predictions[group_mask] == y_test[group_mask])

fairness_report[group] = {

'accuracy': group_accuracy,

'sample_size': sum(group_mask)

}

# 检查显著差异

accuracies = [report['accuracy'] for report in fairness_report.values()]

max_disparity = max(accuracies) - min(accuracies)

print("公平性评估报告")

print("=" * 50)

for group, metrics in fairness_report.items():

print(f"组 {group}: 准确率 = {metrics['accuracy']:.3f}, 样本数 = {metrics['sample_size']}")

print(f"\n最大准确率差异: {max_disparity:.3f}")

if max_disparity > 0.1:

print("⚠️ 警告:检测到显著的公平性差异!")

return fairness_report

# 这是一个简化示例 - 真实的公平性评估需要更复杂的统计技术和领域专业知识Global AI Ethics Initiatives

- 欧盟AI法案:基于风险的AI监管框架

- OECD AI原则:可信AI的国际标准

- IEEE伦理对齐设计:伦理AI的全面指南

- AI合作伙伴关系:应对AI挑战的多利益相关方组织

What You Can Do

- 学习AI伦理原则与框架

- 在组织中倡导伦理实践

- 参与关于AI治理的公共讨论

- 支持多元包容的AI开发团队

- 考虑AI项目更广泛的社会影响

伦理AI并非创新的束缚,而是可持续、有益且可信的AI系统的基础,这些系统服务于全人类。